A crescente popularização dos modelos de linguagem de grande porte (LLMs) locais evidencia uma transformação significativa na forma como usuários comuns e entusiastas lidam com inteligência artificial. A facilidade de acesso a esses modelos diretamente em seus dispositivos elimina dependências tradicionais de serviços na nuvem, promovendo maior privacidade e controle. Entretanto, o desafio principal reside na escolha inicial do modelo adequado, que pode intimidar iniciantes devido à aparente complexidade técnica e variedade de opções disponíveis.

Antes de mais nada, entender a nomenclatura dos modelos é fundamental para desmistificar o processo. Os nomes dos LLMs funcionam como uma espécie de ficha técnica que revela a origem, a capacidade de processamento e o grau de compressão do modelo. Essa quebra de barreiras no conhecimento técnico é essencial, pois permite ao usuário avaliar com maior clareza quais modelos são compatíveis com seu hardware sem precisar ser um especialista em programação ou arquitetura de IA.

Outro ponto crucial na utilização de LLMs locais é a consideração do limite físico dos dispositivos, principalmente no que tange à memória disponível. A quantidade de parâmetros de um modelo direta influencia seu consumo de recursos, o que obriga o usuário a equilibrar entre desempenho e capacidade do equipamento. Modelos maiores, embora mais avançados, podem ser inviáveis para máquinas com menor capacidade, enquanto modelos menores oferecem rapidez e praticidade, mesmo com algumas limitações de qualidade nas tarefas mais complexas.

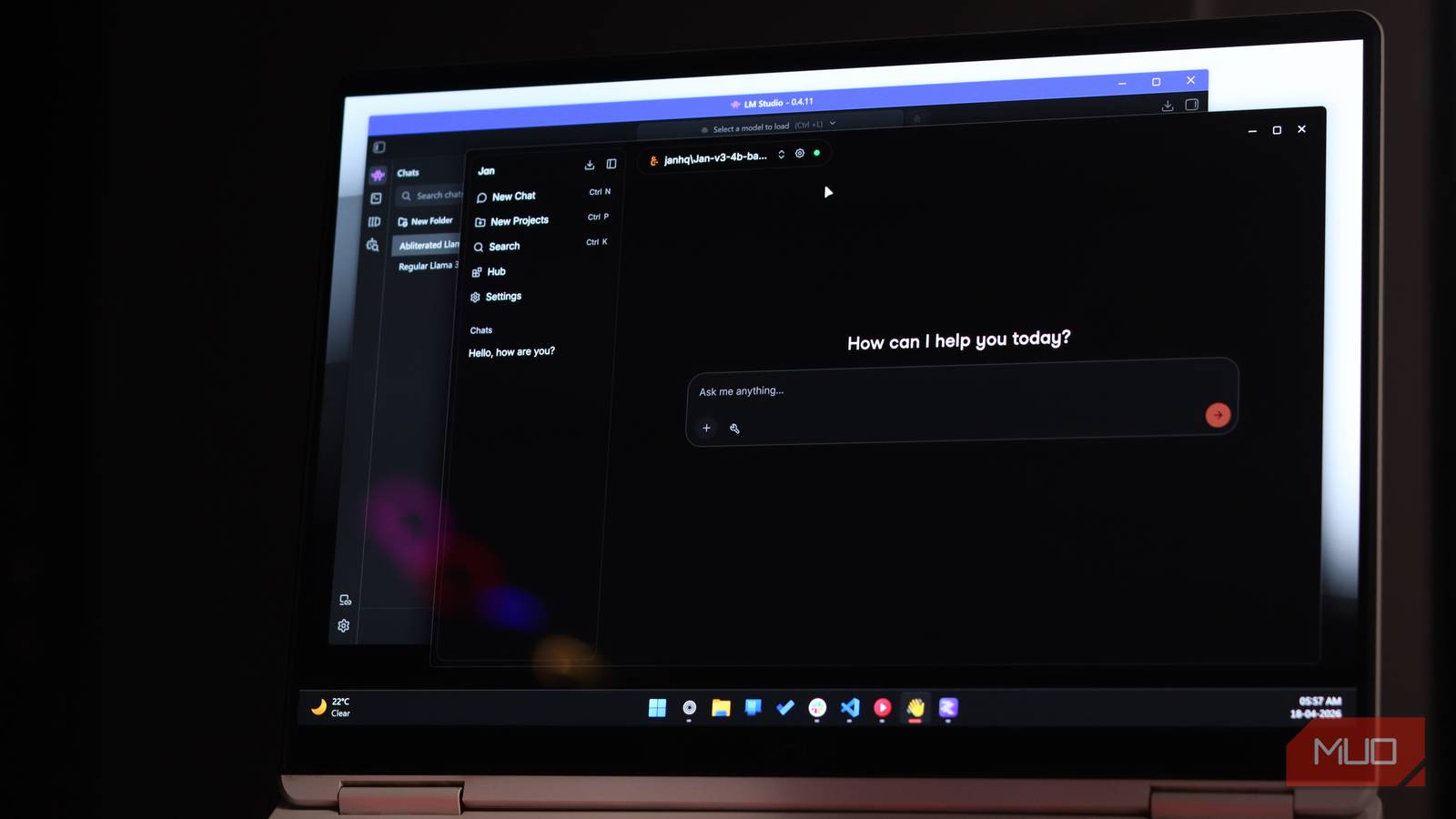

Finalmente, a prática experimental é indispensável para encontrar o modelo ideal para cada necessidade. A diversidade e a rápida evolução do mercado de LLMs locais estimulam uma abordagem flexível na escolha, privilegiando a adaptação e o aprendizado progressivo. Ferramentas que analisam as especificidades do hardware do usuário e sugerem opções viáveis ampliam ainda mais a acessibilidade e diminuem o receio de errar na escolha inicial, incentivando a experimentação contínua.

Portanto, a escolha de um modelo de linguagem local não deve ser encarada como um obstáculo intransponível, mas sim como um processo de descoberta e ajuste que reflete as condições e objetivos individuais de cada usuário. Ao compreender a estrutura dos modelos, respeitar as limitações do hardware e adotar uma postura experimental, qualquer pessoa pode tirar proveito dessa tecnologia emergente, promovendo um uso mais autônomo, eficiente e personalizado da inteligência artificial.

Fonte: https://www.makeuseof.com/picking-your-first-local-llm-easier-than-internet-makes-it-sound/

Comentários

Postar um comentário